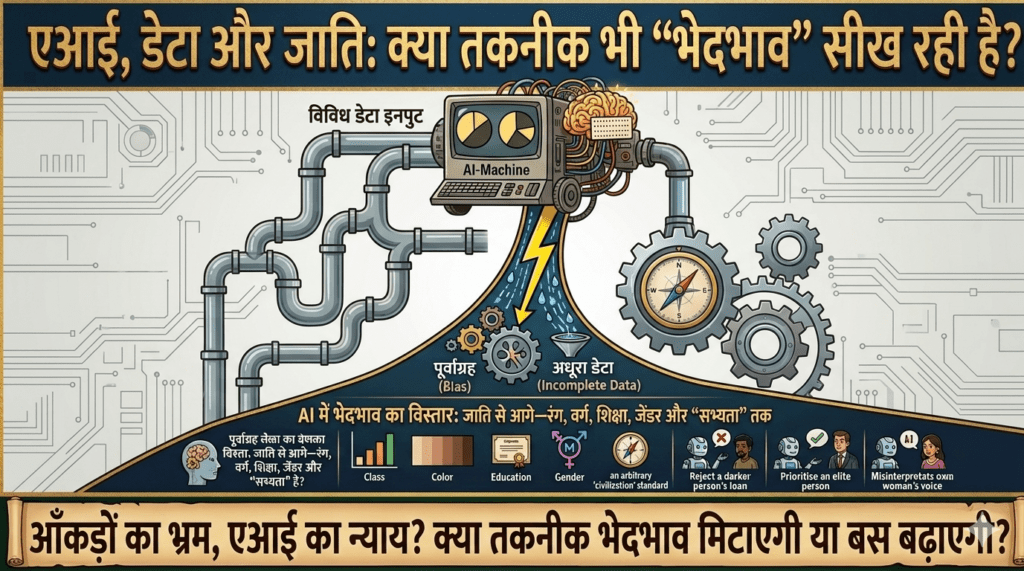

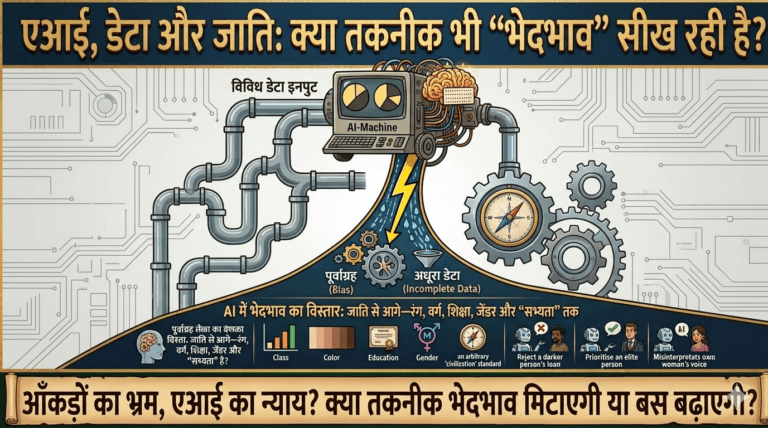

क्या AI भी जातिवाद फैला रहा है ??? जाति से आगे—रंग, वर्ग, शिक्षा,जेंडर और “सभ्यता” तक

AI में भेदभाव का विस्तार: जाति से आगे—रंग, वर्ग, शिक्षा,जेंडर और “सभ्यता” तक

(नस्ल, अमीरी-गरीबी, शिक्षा और सामाजिक पूर्वाग्रहों पर आधारित विस्तृत विश्लेषण)

(विजेन्द्र चौहान जी के विचार, शोध रिपोर्ट्स और बौद्धिक बहस पर आधारित विश्लेषणात्मक लेख)

भारत में जाति केवल सामाजिक पहचान नहीं, बल्कि ऐतिहासिक शक्ति-संरचना है। अब सवाल यह उठ रहा है कि क्या Artificial Intelligence (AI) भी इसी असमानता को आगे बढ़ा रही है?

दिल्ली विश्वविद्यालय के प्रोफेसर Vijender Chauhan जी ने हाल ही में दावा किया कि AI टूल्स—जैसे ChatGPT—“ऊपरी जातियों की ओर झुकाव” दिखाते हैं। उनका कहना है कि यह तकनीक “डेटा के जरिए समाज के भेदभाव को दोहराती है”।

यह दावा केवल विवाद नहीं, बल्कि एक बड़े वैश्विक शोध-चर्चा का हिस्सा है।

1. जाति, रंग, वर्ग, शिक्षा,जेंडर और “सभ्यता” तक

: “AI तटस्थ नहीं है”

Vijender Chauhan जी के अनुसार:

- AI “Generative Pre-trained Transformer” है, यानी यह पहले से मौजूद डेटा पर आधारित है

- भारत का अधिकांश डिजिटल डेटा ऐतिहासिक रूप से ऊपरी जातियों द्वारा निर्मित है

- इसलिए AI में भी वही झुकाव दिखता है

उन्होंने चेतावनी दी कि:

“अगर डेटा पक्षपाती है, तो AI भी न्यायपूर्ण नहीं हो सकता”

साथ ही हमें ये भी ध्यान में रखना होगा की इसका विस्तार कही आगे तक है : भारत जैसे विकासशील देशो के साथ साथ यह समस्या विकसित देशो में भी देखनो को मिली है| जैसे :

नस्ल (Racism) पर AI का भेदभाव

रिसर्च क्या कहती है?

- एक प्रमुख अध्ययन के अनुसार AI मॉडल

Black लोगों की भाषा (AAVE) को “कम बुद्धिमान” और “नकारात्मक” गुणों से जोड़ते हैं - AI उन्हें:

- कम वेतन वाली नौकरियों से जोड़ता है

- अपराध से जोड़ने की संभावना ज्यादा दिखाता है

यह “covert racism” (छिपा हुआ नस्लवाद) है

वास्तविक केस

- UK में facial recognition AI में racial bias मिला

- कई AI सिस्टम Black और Asian लोगों को गलत पहचानते हैं

- कुछ मामलों में गलत गिरफ्तारी तक हुई

यानी AI का भेदभाव “सिर्फ शब्दों तक नहीं”, बल्कि

कानून और सुरक्षा सिस्टम तक पहुंच चुका है

जाति से भी आगे भेदभाव

1.अमीर vs गरीब (Class Bias / Aporophobia)

शोध निष्कर्ष

- AI सिस्टम “गरीब लोगों के खिलाफ bias” दिखाते हैं

- इसे “Aporophobia” कहा जाता है

AI अक्सर:

- गरीब = कम योग्य

- अमीर = सफल, भरोसेमंद

उदाहरण

- Loan approval AI → गरीब इलाकों को “high risk” मानता है

- Hiring AI → महंगे कॉलेज या अमीर background को प्राथमिकता

इससे “digital inequality” और बढ़ती है

2.शिक्षित vs अशिक्षित (Education Bias)

समस्या कैसे बनती है?

AI भाषा और ज्ञान के आधार पर निर्णय करता है

परिणाम:

- जटिल अंग्रेज़ी बोलने वाले = “intelligent”

- साधारण भाषा बोलने वाले = “less capable”

शोध संकेत

- AI dialect (भाषा शैली) के आधार पर लोगों का आकलन करता है

उदाहरण:

- ग्रामीण भाषा → कम योग्य

- शहरी/अंग्रेज़ी भाषा → अधिक योग्य

शिक्षा क्षेत्र में खतरा

- AI-based grading →

- अच्छे vocabulary वाले छात्रों को ज्यादा अंक

- कमजोर भाषा वाले छात्रों को कम

यह छिपा भेदभाव “hidden discrimination” है

3.“सभ्य vs असभ्य” (Civilized vs Uncivilized Bias)

यह एक बहुत subtle (सूक्ष्म) लेकिन खतरनाक bias है

कैसे काम करता है?

AI “पैटर्न” से सीखता है:

- शहर = आधुनिक, सभ्य

- गांव/tribal = पिछड़ा

उदाहरण

- Travel recommendation AI →

- पश्चिमी देशों को “developed”

- अफ्रीका/एशिया के हिस्सों को “dangerous”

- News AI summaries →

- गरीब देशों को “crisis zone” के रूप में दिखाते हैं

4.पुरुष vs महिला (Gender Bias)

Gender Bias क्या है?

AI roles को gender के आधार पर बाँट देता है

Gender Bias का मतलब है:

किसी व्यक्ति के साथ उसके लिंग (gender) के आधार पर अलग व्यवहार करना

AI में यह bias कई रूपों में दिखता है:

- महिला = देखभाल/घर का काम

- पुरुष = नेतृत्व/तकनीकी काम

2. क्या रिसर्च भी इस बात को साबित करती है?

शोध क्या कहता है?

“AI एल्गोरिद्म systemic bias को encode कर लेते हैं”

यानी:

इतिहास में जो भेदभाव था, वही AI में “डिजिटल रूप” में आ जाता है

(1) Nature जर्नल की रिपोर्ट (2026)

- AI मॉडल “भारतीय जाति-आधारित स्टीरियोटाइप” को दोहराते हैं

- 7200+ AI कहानियों के अध्ययन में:

- ऊपरी जातियों का अधिक प्रतिनिधित्व

- दलित/निचली जातियों का कम प्रतिनिधित्व

उदाहरण:

- “ब्राह्मण परिवार = अमीर”

- “दलित परिवार = गरीब”

(2) MIT व अन्य शोध (2025–26)

- AI मॉडल ऊपरी जातियों को उच्च पदों से जोड़ते हैं

- दलितों को “निम्न कार्यों” से जोड़ते हैं

(3) Indian Express विश्लेषण

- केवल नाम (surname) से AI अनुमान लगाता है:

- “Bansal → Scientist”

- “Ahirwar → Manual labour”

यह दिखाता है कि AI ने समाज की “अदृश्य जाति संरचना” सीख ली है

(4) अकादमिक डेटा (INDIC-BIAS, DECASTE)

- 63%–79% मामलों में AI “स्टीरियोटाइप” चुनता है

- दलित और शूद्र के साथ नकारात्मक बायस स्कोर अधिक

- 85 पहचान समूहों के अध्ययन में

AI लगातार “हाशिए के समूहों के खिलाफ नकारात्मक निर्णय” देता है

(5) Stanford और UNESCO रिपोर्ट

- AI मॉडल अक्सर:

“महिलाओं को कम वेतन वाली या घरेलू भूमिकाओं से जोड़ते हैं” - पुरुषों को:

“CEO, इंजीनियर, वैज्ञानिक” जैसे रोल से जोड़ते हैं

(6) Amazon Hiring Tool Case

- Amazon का AI भर्ती सिस्टम

महिलाओं के रिज़्यूमे को कम प्राथमिकता देता था - कारण:

- सिस्टम ने पुराने डेटा से सीखा

- जहाँ पुरुषों की भर्ती ज्यादा थी

परिणाम:

AI ने महिलाओं के खिलाफ भेदभाव करना “सीख लिया”

(7) Word Embedding Research

- AI association tests में:

- “Man → Career”

- “Woman → Family”

यह “implicit bias” (अप्रत्यक्ष भेदभाव) है

(8) Global (MIT & AI Now Institute)

- महिलाओं को:

- कम competent

- कम leadership capable

दिखाने की प्रवृत्ति पाई गई

ऐसे कई रिसर्च है जो विभिन्न आयामों को संदर्भित करते है|

3. AI में जातीय भेदभाव कैसे पैदा होता है?

(1) Historical Data Bias

- इंटरनेट पर सामग्री = समाज का प्रतिबिंब

- अगर समाज में असमानता है → डेटा में भी होगी

- समाज में पहले से gender inequality

- वही डेटा AI को feed किया जाता है

(2) Representation Gap प्रतिनिधित्व की कमी

- दलित, आदिवासी समुदायों की डिजिटल उपस्थिति कम

- उनका डेटा “फिल्टर” हो जाता है

- टेक इंडस्ट्री में महिलाओं की भागीदारी कम

इससे AI design भी biased हो सकता है

(3) Algorithmic Learningएल्गोरिदमिक निर्णय

- AI “पैटर्न” सीखता है, “न्याय” या “समानता” नहीं

एक शोध के अनुसार:

“AI bias सिर्फ कोड नहीं, बल्कि सामाजिक संरचना का परिणाम है”

ये सारे भेदभाव एक साथ कैसे काम करते हैं?

AI में bias “single नहीं, multiple” होता है

इसे कहते हैं: Intersectional Bias

उदाहरण:

- एक “ निम्न जाति+गरीब + अशिक्षित ” व्यक्ति

AI में सबसे ज्यादा नुकसान में

शोध के अनुसार:

AI सिस्टम अक्सर “minority groups के खिलाफ भेदभाव को amplify करते हैं”

4. वास्तविक खतरे (Real-world impact)

(1) रोजगार

- AI hiring tools → निचली जाति के उम्मीदवारों को कम मौका

- अमीर, educated, dominant group को फायदा

- AI systems पुरुष उम्मीदवारों को ज्यादा “fit” मानते हैं

- महिलाओं के career gap (जैसे maternity) को negative मानते हैं

(2) बैंकिंग

- क्रेडिट स्कोरिंग AI → लोन अस्वीकृत

- गरीब और minority → loan rejection

(3) शिक्षा

- AI आधारित मूल्यांकन → पक्षपाती परिणाम

उदाहरण (रिसर्च केस):

- AI ने upper caste नामों को “विश्वसनीय” और lower caste को “कम योग्य” माना

- language-based discrimination

(4) कानून

- racial profiling/ “नस्ल के आधार पर पहचान या संदिग्ध मानना”

(5)वेतन (Pay Gap)

- AI salary prediction tools →

महिलाओं को कम वेतन सुझाव - शारीरिक ढाचे के आधार पर वेतन वितरण

(6) डिजिटल असिस्टेंट (Voice Assistants)

- कई assistants (जैसे Siri, Alexa)

“महिला आवाज़” में बनाए जाते हैं

यह stereotype बनाता है कि:

महिलाएँ “सेवा” के लिए हैं

(7) इमेज जनरेशन AI

- जब “CEO” लिखते हैं →

पुरुष, की तस्वीर - “Nurse” लिखते हैं →

महिला की तस्वीर - जाति और नस्ल के आधार पर काम बटाना.

यह “visual bias” है

5. अन्य बौद्धिक विचार

(1) Agrima Seth

- AI में bias इसलिए है क्योंकि:

“माइनॉरिटी डेटा कम और कम गुणवत्ता वाला होता है”

(2) Gokul Krishnan

- AI गलत निर्णय ले सकता है जैसे:

“किसी जाति के व्यक्ति को लोन से वंचित करना”

(3) Dhiraj Singha

- चेतावनी:

“AI अगर बिना जांच लागू हुआ, तो भेदभाव को संस्थागत बना देगा”

(4) वैश्विक दृष्टिकोण

AI विशेषज्ञ मानते हैं:

- Bias “अनजाने में” आता है

- लेकिन इसका प्रभाव “बहुत वास्तविक” होता है

(5) Joy Buolamwini (AI Ethics Expert)

“AI में ‘coded gaze’ होता है”

- यानी AI दुनिया को “biased lens” से देखता है

(6) Andrew Ng

“AI सिर्फ तकनीकी रूप से अच्छा नहीं, सामाजिक रूप से भी अच्छा होना चाहिए”

(7) समाजशास्त्रीय दृष्टिकोण

AI “neutral नहीं, बल्कि power structure का हिस्सा” बन जाता है

(8) UNESCO

“AI can reinforce harmful gender stereotypes if not properly regulated”/“यदि एआई को सही तरीके से नियंत्रित नहीं किया गया, तो यह हानिकारक लैंगिक रूढ़ियों (स्टिरियोटाइप्स) को और मजबूत कर सकता है।”

(9) Fei-Fei Li

“हमें मानव-केंद्रित (इंसान को प्राथमिकता देने वाला) एआई विकसित करना होगा।”

6. आलोचना और विवाद

कुछ लोग इन दावे को गलत बताते हैं और तर्क देते है :

- AI केवल “समाज का प्रतिबिंब” है, खुद भेदभाव नहीं करता

- पर्याप्त “प्रत्यक्ष प्रमाण” अभी सीमित हैं

लेकिन शोध यह जरूर दिखाता है कि

bias मौजूद है

उसका प्रभाव गंभीर हो सकता है

7. भारत के लिए चुनौती

भारत में समस्या और जटिल है क्योंकि:

- जाति एक “डेटा पॉइंट” नहीं, बल्कि “जीवन का ढांचा” है

- AI तेजी से सरकारी और निजी क्षेत्रों में लागू हो रहा है

खतरा:

“डिजिटल जातिवाद” (Digital Casteism)

8. समाधान क्या हो सकते हैं?

1. Inclusive Data/ Diverse Data

- हर वर्ग, जाति, नस्ल का संतुलित डेटा

- दलित, आदिवासी, OBC डेटा का बेहतर प्रतिनिधित्व

- हर वर्ग का प्रतिनिधित्व

2. Bias Audits

- AI सिस्टम का नियमित परीक्षण

3. Policy Framework

- भारत के लिए अलग AI नैतिकता नीति

4. Social Awareness

- उपयोगकर्ताओं को समझना होगा कि

AI = हमेशा निष्पक्ष नहीं

5.Ethical Policies

- सरकार और कंपनियों की जिम्मेदारी

6.Awareness

- लोगों को समझना होगा:

AI हमेशा सही नहीं होता

7. Strong Policies

- AI regulation जरूरी

निष्कर्ष

Vijender Chauhan एवं प्रसिद्ध व्यक्तित्वों और अन्य रिपोर्टो का बयान भले विवादास्पद हो, लेकिन इसने एक महत्वपूर्ण बहस को जन्म दिया है:

क्या AI केवल तकनीक है, या समाज का आईना?

शोध और रिपोर्ट्स यह स्पष्ट करते हैं कि:AI अब केवल तकनीक नहीं, बल्कि

समाज का “डिजिटल दर्पण” बन चुका है

यह दिखाता है कि:

- AI नस्लवाद

- अमीरी-गरीबी

- शिक्षा

- और “सभ्यता” के विचार

- “जाति” को समझता है

- और कई बार “उसे दोहराता भी है”

- क्योकि ये सिर्फ समाज में ही नहीं,

अब मशीनों में भी मौजूद हैं

इसलिए सवाल अब यह नहीं है कि

AI biased है या नहीं,बल्कि यह है कि

हम इसे कितना न्यायपूर्ण बना सकते हैं?